W miarę jak suwerenność danych i wydajność obliczeniowa stają się strategicznymi czynnikami wyróżniającymi przedsiębiorstwa wdrażające sztuczną inteligencję, zapotrzebowanie na prywatną, lokalną infrastrukturę AI stale rośnie. W odpowiedzi na tę zmianę, QNAP® Systems, Inc., wiodący innowator w dziedzinie rozwiązań obliczeniowych, sieciowych i pamięci masowej, wprowadził dziś na rynek QAI-h1290FX, serwer pamięci masowej Edge AI nowej generacji, zaprojektowany z myślą o umożliwieniu prywatnego wdrażania dużych modeli językowych (LLM), wyszukiwarek (RAG) oraz generatywnych aplikacji AI.

Procesor AMD EPYC™ klasy serwerowej, obsługa akceleracji GPU NVIDIA® RTX™ i dwanaście zatok dysków SSD U.2 NVMe/SATA w QAI-h1290FX zapewniają wydajną, lokalną infrastrukturę AI dla organizacji wymagających wnioskowania o niskim opóźnieniu, pełnej prywatności danych i kontroli operacyjnej – bez polegania na chmurze.

Dzięki opartemu na ZFS systemowi operacyjnemu QuTS hero firmy QNAP, QAI-h1290FX zapewnia integralność danych klasy korporacyjnej, niemal nieograniczoną liczbę migawek i deduplikację inline. Obsługuje natywny dostęp GPU w kontenerach za pośrednictwem Container Station oraz passthrough GPU dla maszyn wirtualnych za pośrednictwem Virtualization Station. Zespoły IT, deweloperzy i grupy badawcze mogą efektywnie uruchamiać modele wnioskowania, generatywne aplikacje AI i potoki RAG z pełną kontrolą nad wydajnością i alokacją zasobów.

Platforma QAI-h1290FX zawiera starannie dobrany zestaw preinstalowanych narzędzi AI, takich jak AnythingLLM, OpenWebUI i Ollama, umożliwiających szybkie wdrażanie prywatnych przepływów pracy LLM. Dodatkowe aplikacje AI, takie jak Stable Diffusion, ComfyUI, n8n i vLLM, są również integrowane w celu rozszerzenia funkcjonalności. Umożliwia to użytkownikom szybkie tworzenie lokalnych platform AI i automatyzację przepływów pracy w bezpiecznym, skalowalnym i w pełni kontrolowanym środowisku.

„QAI-h1290FX zaspokaja rosnące zapotrzebowanie na lokalną infrastrukturę AI” – powiedział Oliver Lam, Product Manager w QNAP. „Chcieliśmy wyeliminować trudności związane z budowaniem stacji roboczej GPU, instalowaniem narzędzi i konfigurowaniem złożonych środowisk. Dzięki QAI-h1290FX użytkownicy mogą wdrażać i uruchamiać swoje modele AI od razu po wyjęciu z pudełka – z pełną kontrolą nad danymi i bez konieczności polegania na chmurze”.

Kluczowe cechy QAI-h1290FX

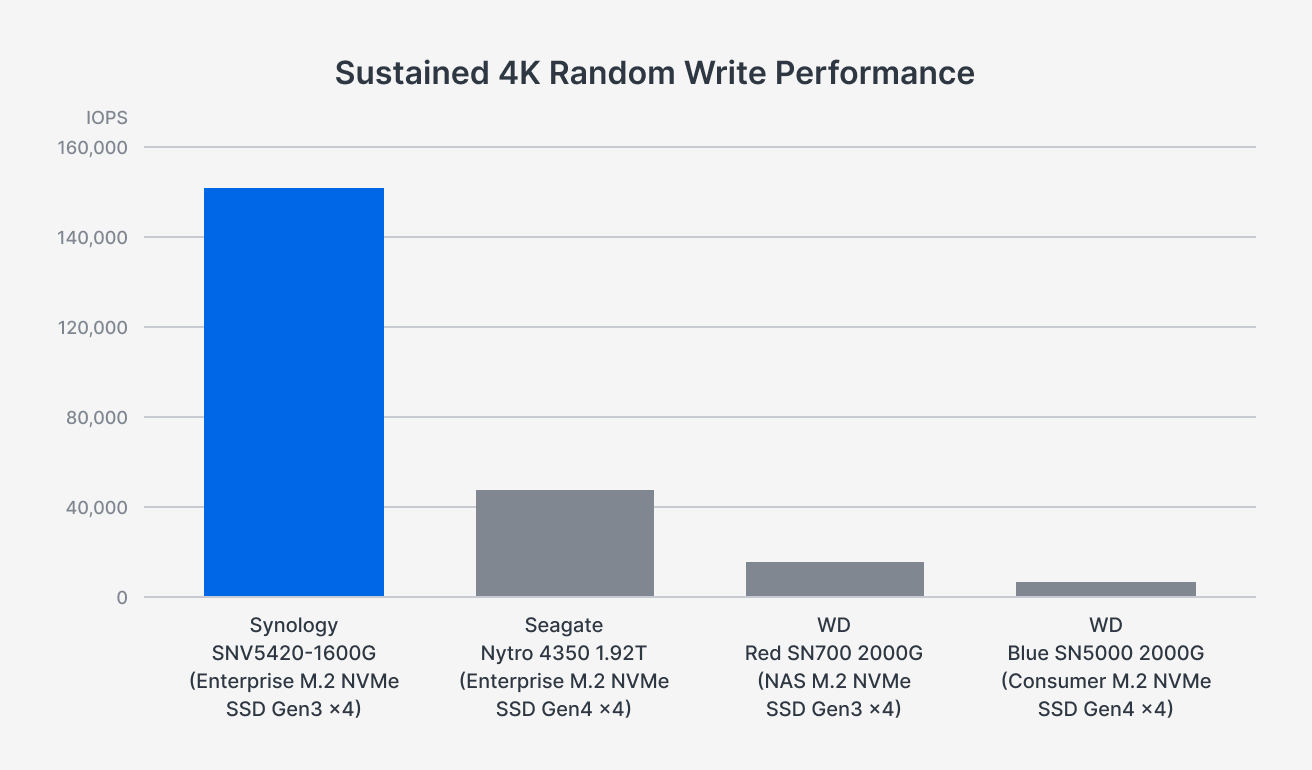

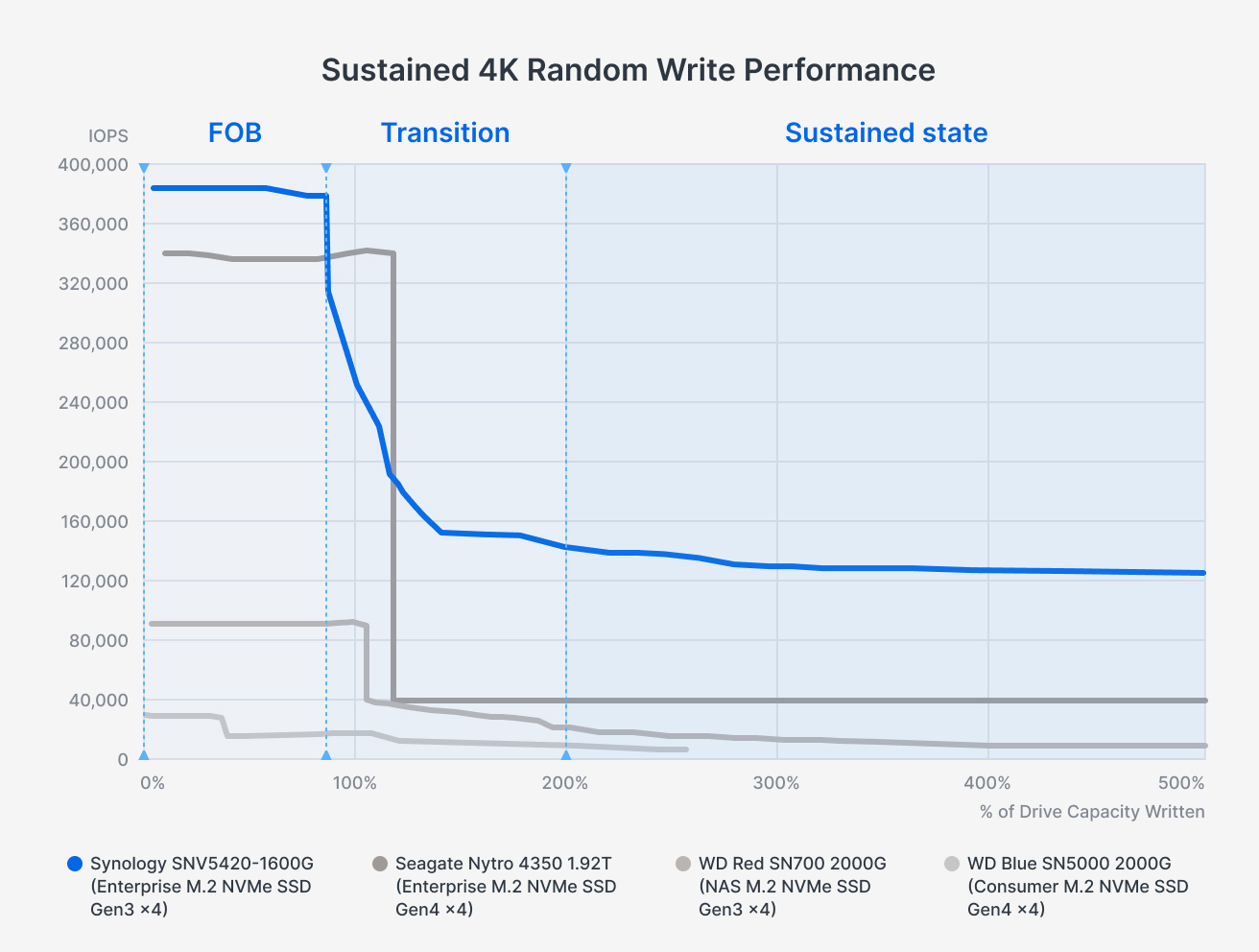

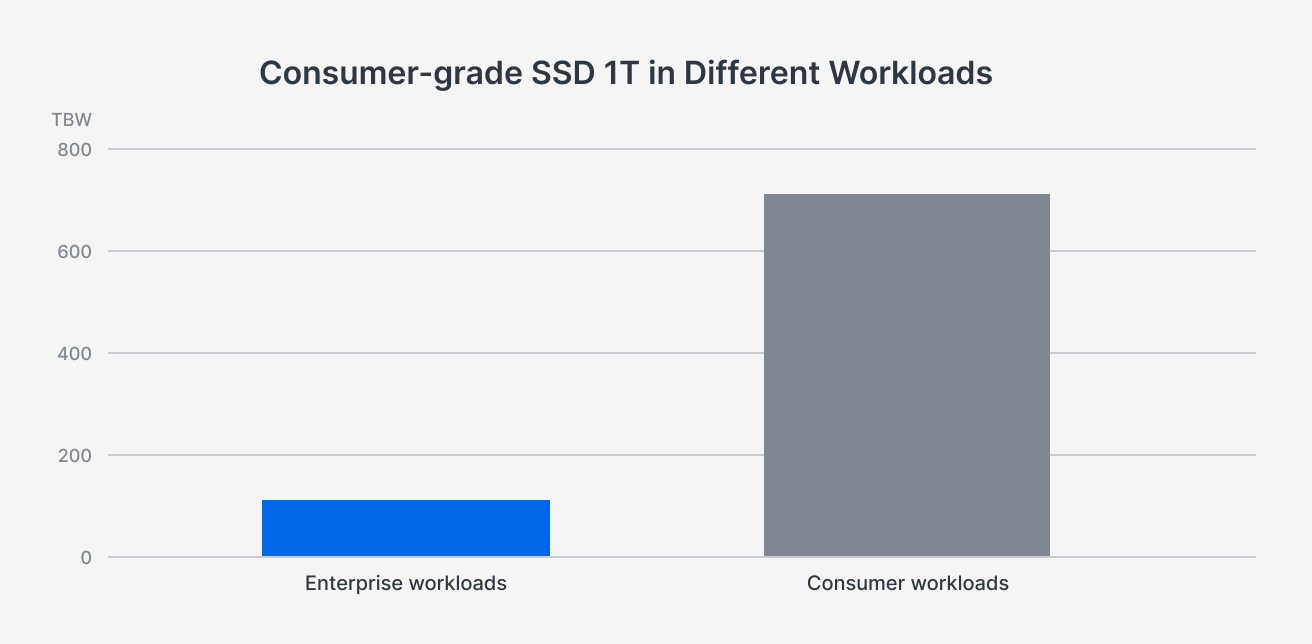

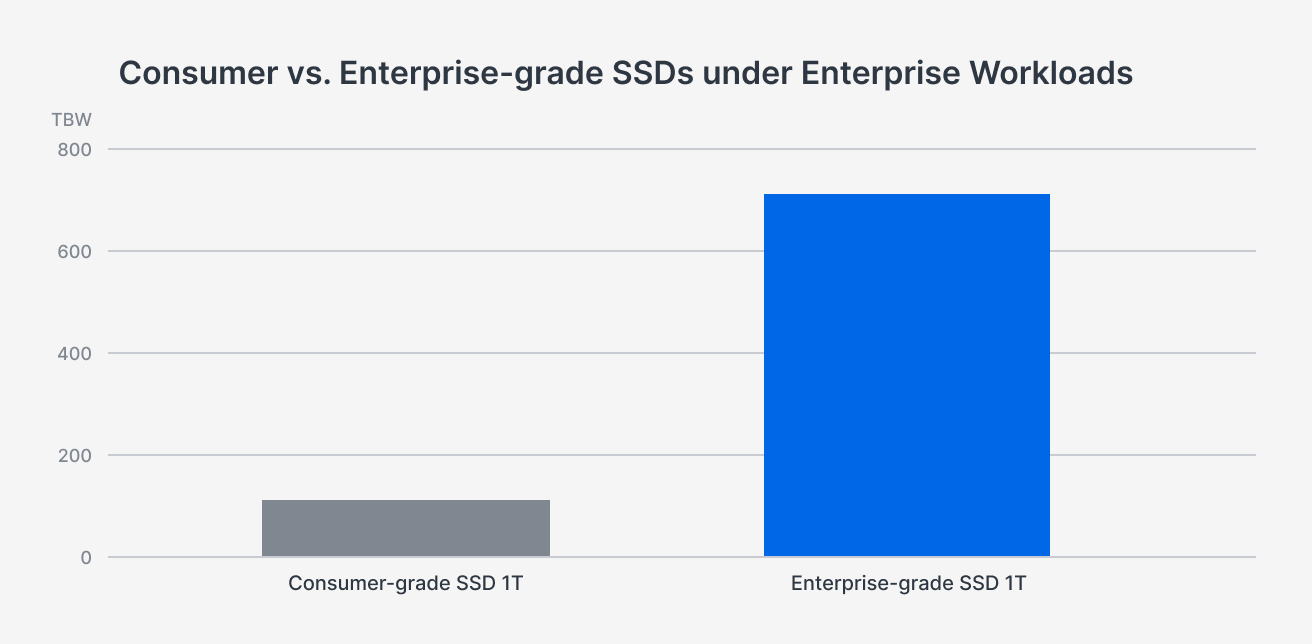

Architektura pamięci masowej All-Flash: Dwanaście gniazd U.2 NVMe/SATA SSD umożliwia ultraszybkie wejście/wyjście do wykonywania modeli AI o wysokiej częstotliwości i strumieniowania danych.

16-rdzeniowy procesor AMD EPYC™ 7302P: Zapewnia 32 wątki mocy obliczeniowej klasy serwerowej — idealne do wnioskowania AI, wirtualizacji i dużych obciążeń równoległych.

Architektura gotowa na GPU: Obsługuje opcjonalny procesor graficzny NVIDIA RTX PRO™ 6000 Blackwell Max-Q Workstation, oferujący do 96 GB pamięci GPU i obsługę akceleracji CUDA®, TensorRT™ i Transformer Engine — znacznie zwiększając wydajność lokalnych obciążeń wnioskowania LLM, generowania obrazów i głębokiego uczenia.

Skonteneryzowane środowisko AI i zarządzanie zasobami GPU: Obsługuje Dockera i LXD z intuicyjną alokacją GPU. Użytkownicy mogą szybko uruchamiać narzędzia AI za pośrednictwem wbudowanego centrum aplikacji AI i przypisywać zasoby GPU bez konfiguracji w wierszu poleceń.

Wdrożenie w pełni lokalne bez zależności od chmury: Uruchamiaj asystentów czatu opartych na AI, wyszukiwarki dokumentów lub bazy wiedzy w pełni lokalnie. Przechowuj poufne dane wewnętrznie, przyspieszając jednocześnie przepływy pracy AI.

Szybka sieć i skalowalna architektura: Dostępne z dwoma portami 25 GbE i dwoma 2,5 GbE. Gniazda PCIe obsługują opcjonalne rozszerzenia 100 GbE. Kompatybilny z obudowami rozszerzającymi QNAP JBOD do przechowywania danych AI na dużą skalę.

Najważniejsze przykłady zastosowań

Wewnętrzni asystenci AI / Lokalne interfejsy czatu

Wdrażaj konwersacyjne interfejsy AI do wyszukiwania wiedzy, szkolenia pracowników i pytań i odpowiedzi dotyczących zasad — w pełni pod Twoją kontrolą.

Wyszukiwanie RAG w przedsiębiorstwie

Wykorzystaj prywatne procesy RAG do szybkiego, kontekstowego wyszukiwania w umowach, raportach i dokumentach wewnętrznych.

Generowanie obrazów dla zespołów kreatywnych

Uruchom platformę Stable Diffusion lub ComfyUI do obsługi przepływów pracy projektowych i generowania treści wizualnych opartych na sztucznej inteligencji.

Automatyzacja IT oparta na sztucznej inteligencji

Użyj n8n do automatyzacji zadań wnioskowania, generowania treści lub alertów — płynnie integrując sztuczną inteligencję z procesami biznesowymi.

Dzięki QAI-h1290FX firma QNAP oferuje praktyczną i wydajną ścieżkę wdrażania generatywnej sztucznej inteligencji w obrębie przedsiębiorstwa. Niezależnie od tego, czy jest ona wykorzystywana w działach prawnych, HR, kreatywnych, czy IT, pomaga zespołom działać szybciej, zachować zgodność z przepisami i zachować pełną kontrolę nad strategią AI — bezpośrednio na brzegu sieci.